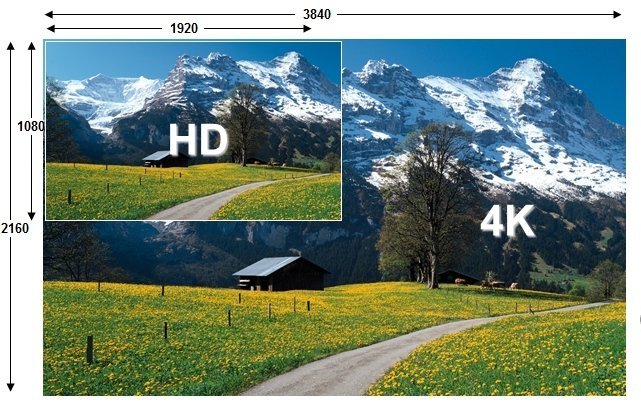

Durante la scorsa generazione abbiamo assistito al passaggio dalla bassa o media risoluzione a quanto è stato battezzato Full HD. Tale cambiamento ha toccato da una parte il giocatore medio, che ha avuto modo di gustarsi il gaming in alta definizione sul televisore di casa, ma molto più in generale ha coinvolto sia il pubblico di massa interessato alla sola fruizione televisiva che di conseguenza le emittenti stesse. Se qualche anno fa le nostre antenne captavano segnali in bassa risoluzione, tutte le più grandi emittenti si sono ritrovate nella posizione di dover investire grosse somme di denaro nell’ampliamento della propria banda. In maniera molto simile, anche le console full HD hanno dovuto garantire caratteristiche tecniche che permettessero il raggiungimento dell’obbiettivo, in primis un bandwidth adeguato da parte della GPU, ma anche una sufficiente quantità di RAM.

Da qualche settimana a questa parte i più grandi produttori di pannelli stanno iniziando la commercializzazione di monitor UHD 4k pensati per il mercato consumer. Ci interessa davvero?

La situazione attuale su PC…

Se andassimo a domandare a un hardcore gamer PC un parere sulla migliore soluzione monitor da gioco, le risposte potrebbero certamente variare parecchio in base ai gusti e alle esigenze, ma è probabile che rimarrebbero alcuni denominatori comuni: latenza sotto i 2 millisecondi, pannello da 24 pollici e full HD. Tralasciando l’ovvio discorso sulla latenza, andiamo a toccare gli elementi che maggiormente ci interessano in questa sede, ovvero dimensioni dello schermo e risoluzione. I 24 pollici sono in linea di massima considerati la dimensione ideale dai giocatori PC, principalmente perché, se pensiamo a una distanza da scrivania, consentono un’ottima visione d’insieme del quadro senza la necessità di muovere la testa. Un po’ meno evidente è però il discorso riguardo la densità.

Infatti, per garantire una densità di pixel per pollice quadrato adeguata (ppi) è necessario che la risoluzione aumenti in maniera direttamente proporzionale all’aumentare delle dimensioni dello schermo. Un monitor da 24 pollici con risoluzione full HD avrà quindi un valore di ppi superiore a quello di un monitor da 26 pollici con la stessa risoluzione, cui conseguirà una maggiore definizione generale.

…E su console

Il mercato console è tendenzialmente diverso: questa tipologia di macchine viene di solito collegata ad una TV piuttosto che ad un monitor, cosa che porta ad una drastica riduzione della qualità visiva in virtù di un ppi molto più basso, ma nel contempo anche ad una minore percezione del problema da parte dell’occhio. Se infatti è norma usare un monitor PC da una distanza di circa 60 centimetri, non è insolito usare una TV da distanze nettamente superiori, andando a perdere nella capacità di cogliere il dettaglio ma guadagnando nel generale colpo d’occhio. Abbiamo quindi più elementi da considerare contemporaneamente: dimensioni dello schermo, risoluzione, densità dei pixel, distanza dell’osservatore.

È comunque assodato che incrementare la risoluzione porta vantaggi sia che si parli di monitor che di TV, in quanto il valore di ppi aumenta in entrambi i casi.

La relatività del ppi

Ma esiste effettivamente un ppi che possa considerarsi soddisfacente e ottimale per il gioco o è meglio cercare di incrementare questo valore ad oltranza? Quanto è importante la distanza di fruizione del contenuto?

Per rispondere a questa domanda prenderemo in esame il florido mercato smartphone, e l’approccio di alcune aziende nei confronti della questione.

Qualche anno addietro, Apple tirò fuori dal cappello una nuova definizione, frutto principalmente di marketing ma piuttosto utile per aiutarci a capire. La definizione era Retina Display. Secondo Apple esisteva infatti un limite di ppi – 326 – che l’occhio umano potesse cogliere da una distanza piuttosto ravvicinata (smartphone). Aumentare questo valore non avrebbe apportato alcun miglioramento alla qualità dell’immagine percepita. Andando sempre a parlare di Retina Display, Apple ammise che questo valore poteva anche abbassarsi, nel caso in cui il device non fosse uno smartphone. Nella fattispecie, l’azienda di Cupertino identificò come valori ottimali 326 ppi per schermi di piccole dimensioni, 264 ppi per dimensioni intermedie (tablet) e 220 ppi per i pannelli più grandi (monitor). Per quanto simili valori e l’intero concetto di Retina Display si siano rivelati scientificamente errati, l’impostazione adottata da Apple ha senso. Il punto fondamentale è che all’aumentare delle dimensioni del pannello la definizione può permettersi di abbassarsi. Questo perché uno schermo dalle dimensioni maggiori porta lo spettatore a porsi a una distanza maggiore.

Pensiamo al salotto di casa nostra. Avere una TV da 32 o 37 pollici ci porta a collocarci ad una certa distanza quando giochiamo o guardiamo le nostre trasmissioni preferite. Ma immaginiamo per un attimo di avere una TV da 55 o magari 80 pollici. Se ci ponessimo alla stessa distanza ci sentiremmo quasi sovrastare dal pannello, perdendo nel colpo d’occhio e peggiorando la qualità generale dell’esperienza. E nel contempo noteremmo tutta una serie di sgranature invisibili su uno schermo di dimensioni più modeste. Allontanarci ci permetterebbe di risolvere entrambi i problemi, e questo è esattamente il motivo per cui quando andiamo al cinema cerchiamo di trovare posto tra le file intermedie piuttosto che tra quelle più avanti.

I problemi del 4k

Capiamo quindi che aumentare la risoluzione è sì cosa buona, ma può di per sé essere quasi del tutto inutile se non accompagnata da altri fattori.

In primo luogo, avere una TV di piccole dimensioni con risoluzione 4k non avrebbe molto senso, in quanto l’incremento del ppi diventa più evidente man mano che le dimensioni del pannello aumentano o che la distanza dall’occhio si riduce. Su TV da salotto da 32 pollici il full HD è di fatto una buona soluzione, che gioverebbe certamente del 4k, ma solo in maniera marginale. In questo caso avremmo un maggiore impatto incrementando gli Hertz e il refresh del pannello, o il contrasto dinamico, o ancora implementando una tecnologia ad OLED. Su schermi più grandi ha invece molto più senso investire in una risoluzione maggiore, così come ha senso farlo sul mercato PC, vuoi perché i PC attuali sono già perfettamente in grado di spingersi oltre i 1080p nel gaming, vuoi perché la produttività aumenta in maniera considerevole in ambiti lavorativi.

La situazione odierna è forse però più arretrata di quanto i media vogliano farci credere. Chi volesse già adesso giocare in 4k dovrebbe per prima cosa spendere oltre 3000 dollari nell’acquisto di un monitor capace di supportare tale risoluzione, ma ovviamente questo non sarebbe sufficiente. Proprio negli ultimi tempi la stampa specializzata d’oltreoceano sta dedicando un certo spazio al discorso del 4k, motivo per cui cominciano ad apparire sulla rete i primi risultati dei benchmark per queste soluzioni. Com’era prevedibile i dati non sono incoraggianti.

Giocare in 4k?

Nessun PC di fascia alta è oggi in grado di far girare software recente in 4k con un buon frame rate e una quantità accettabile di effetti grafici. Le uniche configurazioni in grado di raggiungere performance accettabili sono quelle di fascia enthusiast, accompagnate da soluzioni a tripla o quadrupla scheda. Parlando di GPU sono state AMD Radeon HD 7990 e Nvidia GeForce GTX Titan ad offrire i risultati migliori, ma si parla pur sempre di mostri da circa 1000 dollari per singola scheda. A questo bisogna chiaramente aggiungere un processore all’altezza (anche in questo caso intorno ai mille dollari) e memorie RAM adeguate sia per quanto riguarda la quantità che la qualità. Le texture a risoluzione Ultra HD richiedono com’è ovvio più memoria prima di essere processate, ma una simile quantità di dati trae grande beneficio anche dalla frequenza della RAM stessa. Se il quadro non fosse sufficientemente dispendioso, c’è ancora da tenere conto della questione energetica: tutte queste componenti richiedono un’energia notevole per funzionare in maniera ottimale, cosa che si traduce in costi molto alti per garantire una buona alimentazione, nonché ulteriori costi di “gestione” (la bolletta si paga) e la necessità di un sistema di raffreddamento capace di mantenere il tutto alla giusta temperatura di esercizio.

Nel presente alcuni tra i giochi meglio ottimizzati riescono a girare in 4k anche su configurazioni singola o doppia scheda. Dai test effettuati abbiamo infatti potuto vedere come DIRT 3 si sia comportato egregiamente anche con GPU di fascia media:

*(tutti i test sono stati effettuati senza colli di bottiglia derivanti da altri componenti, i valori tengono presente dei picchi massimi e minimi e rappresentano una media generale)*

DIRT 3 – UHD 4k – Settaggi al massimo

GTX 660 Ti 2GB = 31fps

HD 7950 3GB = 43fps

GTX Titan 6GB = 58fps

HD 7990 6GB = 80fps

Sempre parlando di engine grafici bene ottimizzati sono ottimi anche i risultati di Battlefield 3, seppur non paragonabili a quelli di DIRT 3.

Battlefield 3 – UHD 4k – Settaggi al massimo

HD 7970 GHz Edition = 31fps

HD 7970 GHz Edition Cross Fire = 60fps

GTX Titan 6GB = 60fps

Peggiorano i dati se andiamo invece su Cry Engine:

Crysis 3 – UHD 4k – Settaggi su Very High

HD 7970 GHz Edition Cross Fire = 34fps

La situazione cambia notevolmente nel caso di prodotti più esosi o meno ottimizzati, come può essere il caso di Metro 2033, ancora un buon titolo per effettuare dei test:

Metro 2033 – UHD 4k – Settaggi al massimo

GTX 660 Ti 2GB = 5fps

HD 7950 3GB = 16fps

GTX Titan 6GB = 20fps

HD 7990 6GB = 34fps

La cosa che lascia maggiormente riflettere è che questi test sono stati effettuati con titoli della presente/scorsa generazione. Per quanto il gaming su PC non sia così vincolato al passaggio generazionale così come sulle console, è anche vero che i giochi in arrivo presenteranno tutta una serie di nuove caratteristiche inerenti fisica e grafica che andranno ad appesantire in maniera notevole il compito delle GPU. Per questo motivo è ragionevole presumere che i titoli di nuova generazione saranno ancora meno 4k-friendly per configurazioni standard, salvo che non si vogliano sacrificare tutti gli effetti di post processing o gli shaders.

Se poi andiamo a pensare alla situazione console il discorso diventa ancora più problematico, vuoi perché le limitazioni hardware saranno per forza di cose più marcate rispetto ai PC, vuoi perché – dettaglio da non dimenticare – sviluppare software in uHD è sì più costoso, ma richiede anche parecchio spazio di archiviazione in più, che andrebbe certamente a complicare la vita ad una console. I più grandi manufacturer stanno infatti attenti a cercare di ottimizzare le varie componenti, offrendo lo stretto indispensabile per poter giocare mantenendo bassi i costi di produzione. Emblematico in tal senso l’esempio di Nintendo con Wii U, che nel 2012 ha lanciato sul mercato una macchina con appena 8GB di memoria di archiviazione nella sua versione Basic. Certo, esiste la possibilità di avere più spazio, di aggiungere device esterni e quant’altro, ma chi sviluppa su console ha bisogno di basarsi su dati certi, che sono in linea di massima i valori stock con cui una macchina raggiunge il mercato. PS4 sta in tal senso giocando d’astuzia, lasciando un sistema più aperto che – stando alle ultime dichiarazioni – dovrebbe permettere la sostituzione dell’hard disk, diversamente da Xbox-One.

Sempre parlando di archiviazione, vanno a far sorridere le posizioni adottate da alcune aziende nei confronti del cloud, visto come una sorta di salvatore che permetterà di incrementare le capacità di calcolo delle console e quant’altro. In simili valutazioni non si tiene ovviamente conto di quelle che sono le reali capacità della rete in ogni singolo mercato, e per quanto riguarda quello italiano la situazione è pressoché disastrosa.

Avendo molti soldi da spendere un monitor PC UHD 4k può avere un senso, magari per rigiocare qualche titolo della scorsa generazione in altissima definizione, magari per migliorare la produttività del nostro sistema, o magari semplicemente per farsi trovare pronti per il futuro. Perché che l’Ultra HD sia il futuro è chiaro. Solo non vicino come molti vorrebbero farci credere, almeno nel gaming. Per le console accontentiamoci invece dei nostri LED TV full HD a 800Hz, la prossima generazione in fondo è già qui.